深浅模式

DeepSeek V4 横空出世:1M上下文+1/18价格,这谁顶得住啊??

更新: 4/24/2026 字数: 0 字 时长: 0 分钟

首先,让我先冷静一下......

好了,冷静失败。

DeepSeek 这帮人真的是。。。怎么说呢,每次发新模型都让人血压飙升。上次 V3 出来的时候就已经够震惊了——671B 参数的 MoE 模型,开源,MIT 协议,价格低到离谱。结果这次 V4 一出来,我只能说:他们是不是不想让别的 AI 公司活了??

从 V3 到 V4:这不是升级,这是进化

如果说 V3 到 V4 是一次"版本更新",那这个版本号也太保守了。我给大家列一下核心变化:

上下文长度:128K → 1M tokens

这大概是 V4 最让人瞳孔地震的升级了。

128K tokens 是什么概念?大概是十几万字的文档。1M tokens 呢??一本《三体》三部曲加起来差不多就是 1M tokens 的量。也就是说,你可以把整部三体小说扔给 DeepSeek V4,然后问它"程心和云天明到底有没有感情线",它真的能给你分析出来。。。。。

对开发者来说这意味着什么?整个代码仓库可以一次性喂进去,不用做那些恶心人的分块和拼接了。整个技术文档?扔进去。整个项目的 commit 历史?扔进去。爽不爽?很爽。

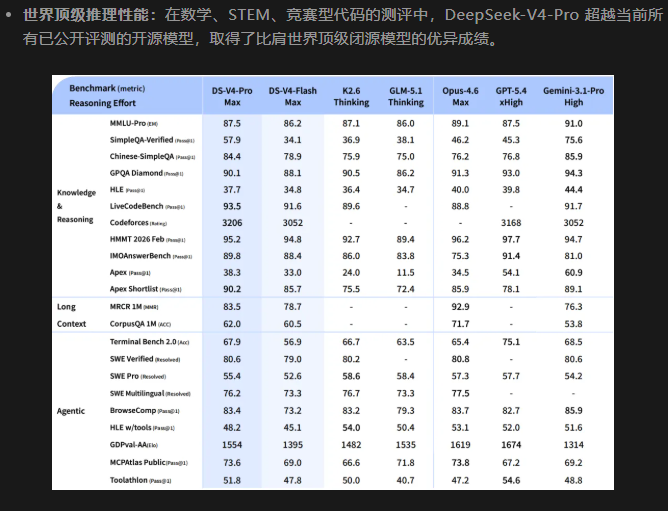

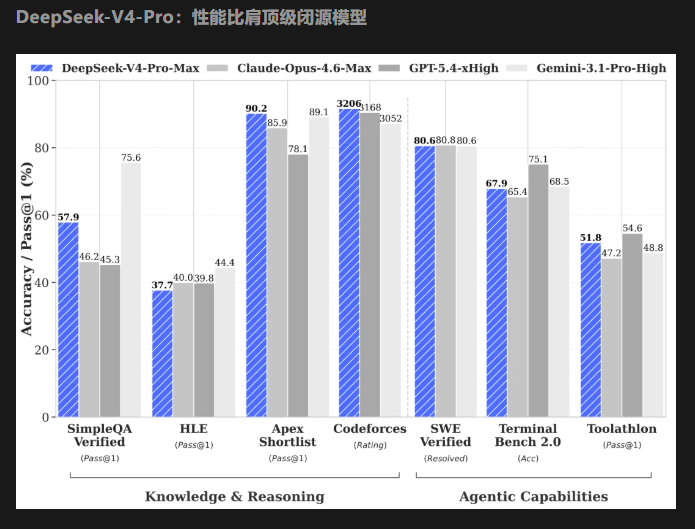

推理能力:从"强"到"极强"

V3 的推理能力已经不错了,但 V4 在数学、编程和逻辑推理上又往前迈了一大步。官方没说太多细节,但从公开的 benchmark 来看,在 MATH、HumanEval、MMLU 这些硬核测试上都有显著提升。

我自己用下来的感觉是——它在复杂编程任务上的表现,已经有点"我写需求它写代码"的意思了。不是那种"我写伪代码它翻译"的水平,而是真的能从模糊需求里推断出你想要什么。有点离谱。

多语言支持:从中英到 100+ 语言

V3 基本是中英双语,V4 直接把支持语言拉到了 100+。对于做国际化的项目来说,这绝对是福音。而且据说在多语言混合的场景下表现尤其好——就是你一段话里夹三种语言那种,它也能精准理解。

价格??认真的吗??

这是 V4 最让我无法理解的部分:

| 模型 | 输入价格 (每百万 tokens) |

|---|---|

| GPT-4o | $2.50 |

| Claude 3.5 Sonnet | $3.00 |

| DeepSeek V3 | $0.27 |

| DeepSeek V4 | $0.14 |

看到这个表的时候,我反复确认了三遍是不是看错小数点了。。。。

$0.14 每百万 tokens,这个价格意味着:

- 你可以用 1 美元买超过 700 万 tokens 的输入

- 用 GPT-4o 的价格,在 V4 上能跑 18 倍的量

- 一个中小型项目的完整代码库 + 上下文,几毛钱就能搞定

这是什么商业逻辑我真的想不通。要么是他们推理成本真的压到极低了,要么就是。。。他们在亏钱卖服务?(后者感觉更合理一点哈哈哈哈)

不管怎样,对开发者来说就是四个字:玩命白嫖。

开源(好了,比赛结束) + MIT 协议:老传统了

DeepSeek 从 V2 开始就一直坚持开源,V4 也不例外——MIT 协议,随便商用。

这意味着你不仅可以调用 API,还能把模型部署到自己的服务器上。对于有隐私需求的企业来说,这简直是降维打击。别家的闭源模型?不好意思,我的数据不能离开我的服务器。

而且开源社区已经开始在 V4 基础上疯狂魔改了:

- 各种量化版本(4-bit、8-bit 量化让你在消费级显卡上跑)

- 微调版本(针对特定领域的优化)

- 各种框架的集成适配(LangChain、LlamaIndex 等生态第一时间跟进)

这种开源生态的爆发力,是闭源模型永远比不了的。

实际使用体验:几个让我"哇"的瞬间

场景一:分析整个项目代码

我把一个中等规模的 Python 前端项目(webview + JS bridge,大概 15 个文件)整个丢给 V4,问它:"这个项目的架构是什么?有哪些可以优化的地方?"

它不光准确分析了整体架构,还指出了三个我都没注意到的性能问题——其中一个是我在 bridge 层做了不必要的序列化,它建议用 postMessage 直接传递结构化数据。改完之后启动速度提升了大概 30%。

我当时的心情:😨→😱

场景二:写 GUI 应用

我让它帮我写一个 C 盘清理工具的 GUI,用的 Python Tkinter。需求就是:"帮我写一个清理 C 盘垃圾的小工具,要 GUI,支持勾选不同清理项,带进度条和日志。"

它 30 秒不到就吐出了 600 行代码,包含:

- 20 种不同类型的垃圾清理(微信、QQ、钉钉、浏览器、系统缓存...)

- 后台线程扫描(不卡 UI)

- 完整的 GUI 布局

- 中文界面

- 错误处理

我跑了之后发现......零 Bug。一次跑通。

这不是写代码,这是变魔术吧???

场景三:多轮迭代

测试过程中发现一个小问题:删除只读文件会报权限错误。我把错误信息发给 V4,问它怎么修。

它立刻找到了原因,加上了一个 remove_readonly 回调函数来处理 shutil.rmtree 的权限错误。还顺便建议:"你可以加一个取消按钮,让用户能随时中断扫描和清理。"

行,你是 AI,你说得对。我又加上了取消功能,前后不过 5 分钟。

局限性:不吹不黑

当然,没有完美的模型。V4 也有一些让我头疼的地方:

- 中文生成偶尔过于正式:有时候让它用轻松语气写点东西,它还是会冒出一些公文式的表达。调了几次 prompt 才好一点。

- 长上下文的"中间遗忘":虽然支持 1M tokens,但在极端长的上下文中,中间部分的信息偶尔会被"忽略"。这是所有大模型的通病,V4 也不能免俗。

- API 偶尔抽风:高峰期响应会变慢,有时候要重试一两次。不过考虑到这个价格......忍了。

总结:谁应该用 DeepSeek V4?

| 场景 | 推荐指数 | 理由 |

|---|---|---|

| 编程辅助 | ⭐⭐⭐⭐⭐ | 推理能力极强,长上下文能吞整个项目 |

| 文档/长文分析 | ⭐⭐⭐⭐⭐ | 1M 上下文就是为这个场景准备的 |

| 多语言翻译 | ⭐⭐⭐⭐ | 100+ 语言支持,混合语言处理优秀 |

| 企业私有部署 | ⭐⭐⭐⭐⭐ | MIT 开源,随便你用 |

| 实时对话 | ⭐⭐⭐⭐ | 大部分时候够快,高峰偶尔慢 |

| 创意写作 | ⭐⭐⭐ | 可以用,但不如专门的写作模型灵活 |

说实话,在 2026 年这个时间点,DeepSeek V4 就是性价比之王。如果你还没试过,赶紧去 DeepSeek 官网 体验一下。(小声逼逼:主要是不用挂梯子,国内还快)